Informationssicherheit und Datenschutz (ISDS) Konzept made easy

Im digitalen Zeitalter, in dem Daten und Informationen das neue Gold darstellen, hat sich die Informationssicherheit und der Datenschutz (ISDS) zu einem kritischen Anliegen für Unternehmen weltweit entwickelt.

Das aus dem 18. Jahrhundert stammende Sprichwort: „a good preparation is half the battle“ hat sich im Laufe der Zeit für die unterschiedlichsten Herausforderungen bewährt. Für die Erstellung eines ISDS-Konzepts gilt dies genauso. Durch unsere langjährige Erfahrung können wir Ihnen heute praktische Tipps & Tricks zur Erstellung eines ISDS-Konzepts weitergeben. Ob Sie ein kleines Startup oder ein etabliertes Unternehmen sind, die Bedeutung eines soliden ISDS-Konzepts kann nicht überschätzt werden.

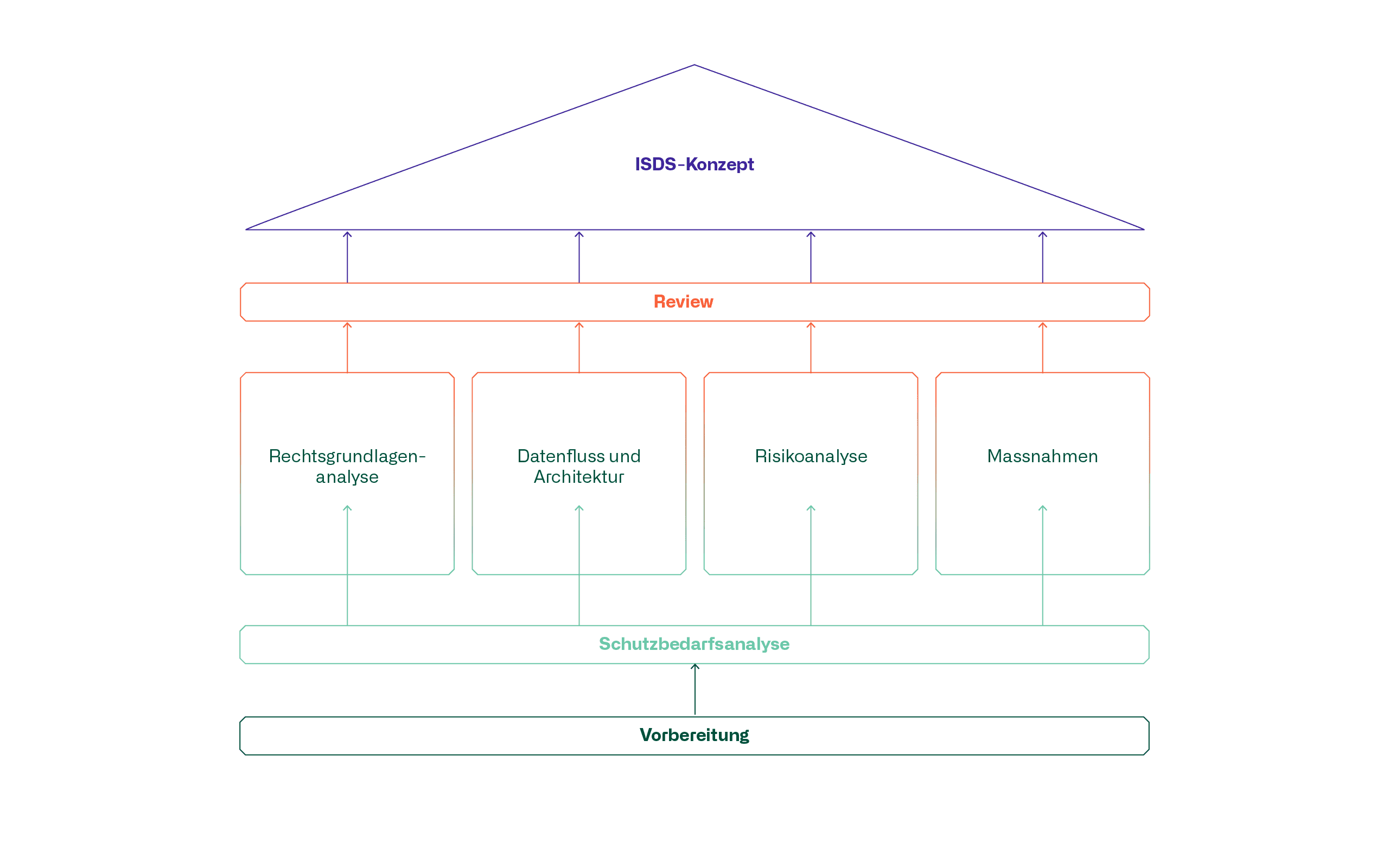

Die Säulen eines ISDS-Konzepts

Ein gutes ISDS-Konzept basiert auf einem soliden Fundament bestehend aus der Vorbereitung und Schutzbedarfsanalyse sowie den nachfolgend abgebildeten vier Säulen.

Vorbereitung

Die Vorbereitung ist der Grundstein eines jeden erfolgreichen ISDS-Konzepts. Bevor Sie tief in die Materie eintauchen, ist es entscheidend, alle beteiligten Rollen zu identifizieren.

Die für die Erstellung eines ISDS-Konzepts benötigten Rollen lauten wie folgt:

- Projektleiter

- IT-Architekt

- Informationssicherheitsbeauftragter

- Datenschutzberater

- Dateneigner und/oder Risikoeigner

- Risikomanager

- Rechtsabteilung

Der Projektleiter ist verantwortlich für die Erarbeitung des ISDS-Konzepts.

Der IT-Architekt kennt die Zusammenhänge, den Umfang sowie das Schema der Applikationen und ist aus diesem Grund prädestiniert dafür die benötigten Angaben zu den Datenflüssen beizusteuern.

Der Informationssicherheitsbeauftragte (ISB) ist dafür verantwortlich, die Risikoanalyse und die vorgeschlagenen Massnahmen zur Behandlung der Risiken auf Plausibilität, Wirksamkeit und Konformität mit der Sicherheitsarchitektur zu prüfen und zu bewerten.

Der Datenschutzberater (DSB) unterstützt den Verantwortlichen oder Auftragsverarbeiter in allen mit dem Schutz personenbezogener Daten zusammenhängenden Fragen.

Der Dateneigner ist zuständig und verantwortlich für die Daten und Informationen innerhalb seines zugewiesenen Bereiches (Spezifische Applikation, Service etc.). Er erstellt die Schutzbedarfsanalyse im Rahmen des ISDS-Konzepts.

Der Risikoeigner entscheidet über die Restrisiken unter Berücksichtigung des Risikoappetits des Unternehmens. Er nimmt somit die vorgeschlagenen Massnahmen zur Reduktion der Risiken ab und trägt mit der Abnahme die Restrisiken des Unterfangens.

Der Risikomanager wird im Nachgang des ISDS-Konzepts über die unternehmensrelevanten Risiken informiert. Er stellt sicher, dass jegliche Formalitäten (Freigabeprozess, Dokumentation, etc.) eingehalten wurden.

Die Rechtsabteilung besitzt das Fachwissen, um eine korrekte Rechtsgrundlagenanalyse zu erstellen. Diese Analyse ist sehr individuell. Je nachdem ob ein Unternehmen öffentlich oder privat ist, ob das Unternehmen in speziellen Branchen tätig ist, können ganz unterschiedliche gesetzliche beziehungsweise regulatorische Anforderungen gelten, welche sich auf das Vorhaben und dessen Risiken und Massnahmen auswirken.

Schutzbedarfsanalyse

Die Schutzbedarfsanalyse ist der Startpunkt im Prozess der Entwicklung eines ISDS-Konzepts. Sie zielt darauf ab, die kritischen Werte zu identifizieren und deren Schutzbedarf anhand einer gewählten Klassifizierung z.B. Bundesamt für Sicherheit in der Informationstechnik (BSI IT-Grundschutz), International Organization for Standardization (ISO 27001) etc. zu bewerten. Grundsätzlich geht es darum die Schutzziele Vertraulichkeit, Verfügbarkeit, Integrität und Nachvollziehbarkeit zu beurteilen und ihnen ein Schutzniveau zuzuweisen: z.B. normaler, hoher oder sehr hoher Schutzbedarf. Sollte sich nach der Schutzbedarfsanalyse herausstellen, dass kein erhöhter Schutzbedarf vorliegt, ist man hier auch bereits am Ende und muss kein ISDS-Konzept erstellen, sofern die IT-Grundschutzmassnahmen des Unternehmens eingehalten werden.

Die Schutzbedarfsanalyse kann effizient erstellt werden, wenn dazu eine Vorlage benutzt wird, welche mittels unternehmensspezifischer Fragestellungen und Drop-Down Antworten automatisch den passenden Schutzbedarf pro Schutzziel ausweist.

Rechtsgrundlagenanalyse

Die Rechtsgrundlagenanalyse befasst sich mit den externen Vorgaben (Gesetze und Regulatorien) sowie den internen Vorgaben (Governance).

Die zentralen Fragen, die durch die Rechtsgrundlagenanalyse beantwortet werden müssen, beziehen sich auf die Risiken in Folge von Verletzungen von Compliance bzw. Governance Vorgaben:

- Was: Spricht irgendetwas dagegen, das ich mein geplantes Vorhaben umsetzen darf?

- Wie: Spricht irgendetwas dagegen, wie ich mein geplantes Vorhaben umsetze?

Kernpunkt ist, dass dem Unternehmen bekannt und bewusst ist, welche Vorgaben einzuhalten sind. In den meisten Fällen beziehen sich diese Vorgaben speziell im Bereich der Umsetzung auf das Datenschutzgesetz.

Wenn sich der aktuelle Geschäftsfall nicht signifikant von vorausgehenden Projekten oder dem Kerngeschäftsfeld unterscheidet, kann die Rechtsgrundlagenanalyse je nach Risikoappetit übernommen werden. Ggf. kann auch eine Legal-Opinion aus Branchenverbänden herangezogen werden; solche Grundsätze haben eine breite Abstützung.

Datenfluss und Architektur

Ein Datenflussdiagramm stellt dar, wie Daten durch ein System fliessen, einschliesslich der Quellen, Ziele, Speicher und Prozesse, die die Daten bearbeiten. Diese Visualisierung hilft, ein klares Verständnis davon zu entwickeln, wie Informationen durch die Organisation bewegt werden, was für die Identifizierung potenzieller Sicherheitsrisiken und Abhängigkeiten entscheidend ist.

Der Fokus der Analyse des Datenflusses liegt auf den Schnittstellen zwischen Systemen.

Mittels Risikoanalyse wird überprüft, ob durch die Nutzung einer Schnittstelle ein zusätzliches Risiko verbunden ist, z.B. ein Übergang von DMZ auf Intranet, Rechenzentrum zu Cloud, oder auch Datenflüsse zwischen Ländern.

Um sicherzustellen, dass die Erhebung der Risiken vollständig ist, sollte man ein besonderes Augenmerk auf die Schnittstellen legen. Die Vollständigkeit der Beschreibung kann mittels Checklisten unterstützt werden.

Risikoanalyse

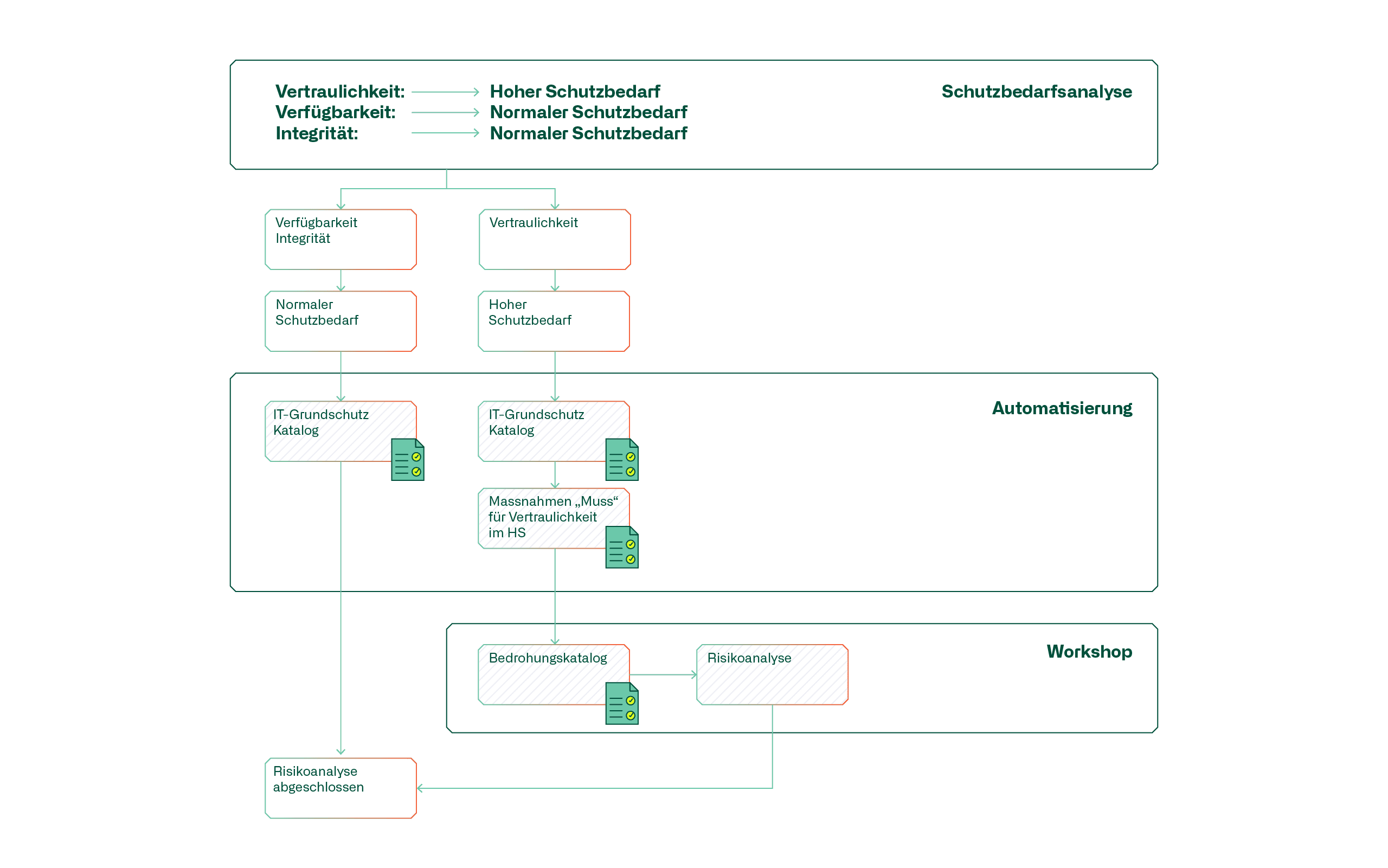

Voraussetzung für eine Risikoanalyse ist, dass das Risikomanagement-Framework sowie die Risikoakzeptanz klar festgelegt sind. Die aus der Schutzbedarfsanalyse stammenden Schutzniveaus der Schutzziele werden mittels Risikoanalyse geprüft, insofern sie den normalen Schutzbedarf übersteigen.

Als erster Schritt bietet es sich an, ein Set von zwingenden Massnahmen zu einem Grundschutz-Katalog zusammenzufassen. Dies ermöglicht den Checklisten-Approach, um die Umsetzung der Massnahmen zu evaluieren. Nicht umgesetzte Grundschutz Massnahmen stellen ein potenzielles Risiko dar, welches mittels der Risikoanalyse behandelt werden muss. Schutzziele, deren Schutzniveau den normalen Schutz übersteigen, müssen in einem nächsten Schritt genauer analysiert werden.

Die folgende Abbildung beschreibt den Ablauf der Risikoanalyse anhand einer fiktiv erstellten Schutzbedarfsanalyse:

Dieses Vorgehen kann mit entsprechenden Tools automatisiert werden und schafft damit genügend Freiraum für die eigentliche Risikoanalyse.

Die Erfahrung hat gezeigt, dass es empfehlenswert ist, die Risikoanalyse in Form eines Workshops bestehend aus dem Projektleiter, dem Architekten sowie dem Informationssicherheitsbeauftragten zu organisieren, um das Projektvorhaben aus Sicht eines Bad Actors zu durchleuchten. Ein Bad Actor würde sich z.B. fragen: In welcher Art und Weise kann ich ein System missbrauchen? An welcher Stelle können Daten gestohlen werden? Wie gross ist die Angriffsfläche eines Insider-Threat, wie werden Angriffe erkannt und verhindert? Diese Fragen werden zu einem Bedrohungskatalog zusammengestellt.

Um sicherzustellen, dass das Projektvorhaben von A bis Z durchleuchtet wird, diskutiert und bewertet man die Risiken aus den identifizierten Bedrohungen in Bezug auf die Systeme und Schnittstellen des Datenflussdiagramms. Der Prozess wird wiederholt unter der Berücksichtigung der risikomindernden Massnahmen, um das Restrisiko ausweisen zu können.

Massnahmen

Das Kontrollieren und Steuern von Massnahmen stellt sicher, dass diese im operativen Betrieb umgesetzt werden. Auch hier bietet sich die Automatisierung an, damit Umsetzungsverantwortliche erinnert werden und ein Reporting ermöglicht wird.

Review

Das hier beschriebene Vorgehen eignet sich für alle Unternehmen. Um das Vorgehen bestmöglich auf das individuelle Unternehmen anzupassen, empfehlen wir die Einführung eines Review-Prozesses, analog eines kontinuierlichen Verbesserungsprozess. Dieser Prozess soll sicherstellen, dass die bei der Erstellung der ISDS-Konzepte gewonnenen Erkenntnisse in den Prozess integriert werden. Ein Fokus liegt dabei auf der Erhöhung des Automatisierungsgrades des ersten Schritts der Risikoanalyse, wobei die definierten Massnahmen aus der vergangenen Review-Periode als Ergänzung für die zwingenden Massnahmen geprüft werden. Zusätzlich konzentriert man sich auf die Weiterentwicklung des Bedrohungskatalogs, als Basis für zukünftige Risikoanalysen.

Sichern Sie mit uns die Zukunft Ihres Unternehmens: Wir helfen Ihnen Ihren individualisierten ISDS-Prozess zu erarbeiten. Unsere langjährige Beratungserfahrung hilft uns dabei, Ihnen zu helfen. Das Erstellen von ISDS-Konzepten sollte kein mühseliges Unterfangen sein. Es geht auch smarter: mit atrete.

Neuer Head of cyber security

Christoph Pfister verstärkt unser Team seit dem 1. März 2024 als Head of cyber security. Wir freuen uns, einen so erfahrenen IT-Spezialisten in unserem Team begrüssen zu dürfen. Mit über 25 Jahren Erfahrung in den Bereichen IT, Medien und Finanzdienstleistungen bringt unser neuer Kollege eine bewährte Erfolgsbilanz im Aufbau, in der Entwicklung und in der Führung leistungsstarker Teams mit. In den letzten Jahren arbeitete er als CIO und Senior Technology Strategy Consultant von finanzmarktregulierten SaaS und IT-Service-Providern und leitete komplexe Cloud Migrations- sowie Go-to-Market Projekte und Programme.

Seine Expertise umfasst das Business-IT Alignment, Technologie- und Cloud-Strategien, Enterprise -Architektur, Produktmanagement und -entwicklung, Markteinführungsstrategien, IT- Governance, Informationssicherheit und Compliance im regulierten Umfeld.

Christoph Pfister hält einen Bachelor of Science in Business Information Technology, einen Master of Science in Business Administration und einen Executive Master of European and International Business Law der Universität St. Gallen. Aktuell vertieft er sein Wissen durch ein Masterstudium in Financial Markets Compliance an der HWZ Hochschule für Wirtschaft Zürich.

Wir sind überzeugt, dass seine umfassenden Kenntnisse und seine innovative Herangehensweise uns dabei helfen werden, unsere Ziele zu erreichen und neue Erfolgsgeschichten zu schreiben.

Medienkontakt:

at rete ag

Marlene Haberer

Telefon: +41 44 266 55 83

Email: marlene.haberer@atrete.ch

atrete baut Consultant-Team weiter aus

In den vergangenen Monaten hat das renommierte Beratungsunternehmen atrete drei neue talentierte Mitglieder in sein Team aufgenommen, um die Bereiche CIO Advisory, Digital Workplace und Cybersecurity zu stärken.

Jessica Knecht unterstützt seit dem 1. April 2023 das Team in der Practice Area CIO Advisory als Associate Consultant.

Frau Knecht bringt umfangreiche Erfahrung im IT-Bereich mit, insbesondere im IT Service Management und Cloud Provider Management. Vor ihrer Tätigkeit bei atrete arbeitete sie mehrere Jahre als Customer Service Managerin bei einem renommierten IT Service Provider. Sie verfügt über einen Abschluss als eidg. Technische Kauffrau und hat ein CAS in IT Sourcing und Provider Management der ZHAW absolviert. Darüber hinaus ist sie zertifiziert im IT Service Management (ITIL Foundation), Requirements Engineering (IREB Foundation) und Microsoft Azure Fundamentals.

Seit dem 1. Juni 2023 ist Vivien Bührer als Consultant im Bereich Digital Workplace und Collaboration tätig.

Frau Bührer verfügt über eine beeindruckende Laufbahn, die unter anderem ihre Zeit als Solution Designer für End User Services bei Fujitsu umfasst. In dieser Rolle betreute sie Ausschreibungen für managed Workplace Services und beriet zu IT Service Management Themen. Sie ist Inhaberin eines Master of Science in Business Analytics, Controlling und Consulting und bringt zudem Qualifikationen wie Scrum Master, Hermes und ITIL Zertifizierungen mit.

atrete heisst Sven Gerig herzlich willkommen, der seit dem 12. Juni 2023 als Consultant die Practice Area Cybersecurity unterstützt.

Herr Gerig kann auf eine erfolgreiche Karriere bei verschiedenen IT-Dienstleistern in der Region Zug zurückblicken, wo er als Projektleiter und Systems Engineer tätig war. Seine umfassenden Kenntnisse spiegeln sich auch in seinen Zertifizierungen wider, darunter Azure Solutions Architect Expert, Cybersecurity Architect Expert und Enterprise Administrator Expert im Bereich Microsoft. Zudem bringt er Qualifikationen wie SAFe® Scrum Master und ITIL 4 Foundation mit. Bald wird er seinen Abschluss als dipl. Informatiker HF Fokus Cyber Security abschliessen.

Medienkontakt:

at rete ag

Marlene Haberer

Telefon: +41 44 266 55 83

Email: marlene.haberer@atrete.ch

Implementierung einer Zero Trust Architektur

Wo stehen wir heute?

Die Verbreitung von Cloud-basierten Diensten, Mobile Computing, Internet of Things (IoT) und Bring Your Own Device (BYOD) verändert die Technologielandschaft für alle Unternehmen. Bestehende Sicherheitsmodelle sind nicht mehr ausreichend, um neue Bedrohungen abzuwehren. Unternehmen müssen ihre Sicherheitsarchitektur überdenken, und es ist naheliegend, dass man sich dann mit dem Modell Zero Trust auseinandersetzt.

Wie bereits einleitend erwähnt ist die Zero Trust Architektur (ZTA) keine neue Erfindung, dieser Ansatz existiert seit einigen Jahren. Doch es gibt nun Lösungen und Möglichkeiten, wie eine solche Architektur sinnvoll und erfolgreich umgesetzt werden kann.

Aus verschiedenen Projekten bei unseren Kunden, aus Guidelines und defacto Standards haben wir ein atrete-Vorgehen, wie eine solche Zero Trust Architektur auch in ihrem Unternehmen eingeführt werden kann.

Zu den grössten Herausforderungen bei der Einführung einer ZTA gehören:

- Nutzung bestehender Investitionen und Abwägung der Prioritäten bei gleichzeitigem Fortschritt

- Die Einführung erfordert die Nutzung der Integration vieler bestehender Technologien mit unterschiedlichem Reifegrad

- Identifizierung von Technologielücken zum Aufbau einer möglichst vollständigen ZTA

- Befürchtung, dass die ZTA den Betrieb oder die User Experience der Endbenutzer beeinträchtigen könnte

- Fehlen eines gemeinsamen Verständnisses von ZTA innerhalb der Organisation

Jedoch gibt es auch viele Vorteile, um hier ein paar zu nennen:

- Unterstützung von Remote-Mitarbeiter mit Zugang zu Ressourcen unabhängig von ihrem eigenen Standort

- Schutz der Ressourcen unabhängig von deren Standort (On-prem oder in der Cloud)

- Begrenzung der Insider-Bedrohung (Insider sind nicht automatisch vertrauenswürdig)

- Begrenzung von Sicherheitslücken (Reduzierung von lateral movement und privilege escalation)

- Verbesserung der Netzwerk-Transparenz, wer auf welche Ressourcen zugreifen und die Erkennung von Vorfällen inklusive Reaktion und Wiederherstellung

- Durchführen einer kontinuierlichen, dynamischen und risikobasierten Bewertung von Ressourcen

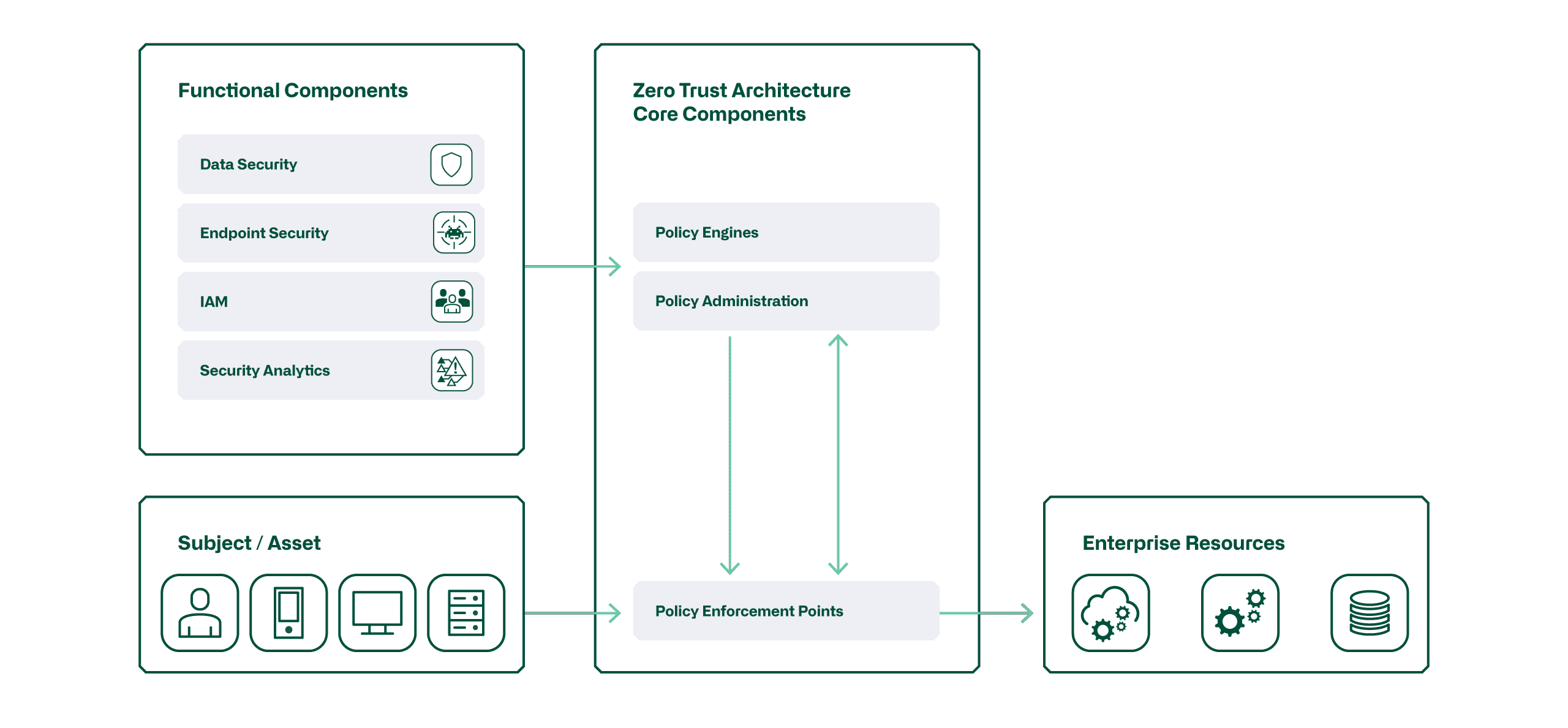

Was beinhaltet eine Zero Trust Architektur?

Zero Trust basiert unter anderem auf dem Prinzip “never trust – always verify“. Die ZTA reduziert das Risiko in allen Bereichen, indem sie eine starke Identitätsüberprüfung einführt, die Konformität von Geräten überprüft und den Zugriff mit geringsten Rechten auf nur ausdrücklich autorisierte Ressourcen sicherstellt.

Zero Trust erfordert, dass jede Transaktion zwischen Systemen (Subjects, Assets und Resources) validiert und als vertrauenswürdig eingestuft wird, bevor die Transaktion stattfinden kann. Die folgende Abbildung zeigt die Hauptkomponenten dieser Architektur:

In einer idealen Zero Trust Umgebung sind die folgenden Verhaltensweisen erforderlich:

- Identitäten werden überall mit Multifaktor-Authentifizierung (MFA) validiert und gesichert, um sicherzustellen, dass nur berechtigte Benutzer auf geschützte Ressourcen zugreifen können.

- Geräte werden verwaltet, um sicherzustellen, dass nur autorisierte Geräte auf geschützte Netzwerke und Systeme zugreifen können. Dazu gehört die Überwachung von Hardware- und Softwarekomponenten.

- Telemetriedaten werden verwendet, um Netzwerke und Systeme zu überwachen und potenzielle Bedrohungen zu erkennen. Dazu gehören die Sammlung von Protokolldaten, Aktivitätsdaten und Metadaten.

- Der Zugriff mit den geringsten Rechten (least privilege) wird durchgesetzt. Der Zugriff beschränkt sich auf die Anwendungen, Dienste und die Infrastruktur, die für die Erfüllung der Aufgaben erforderlich sind.

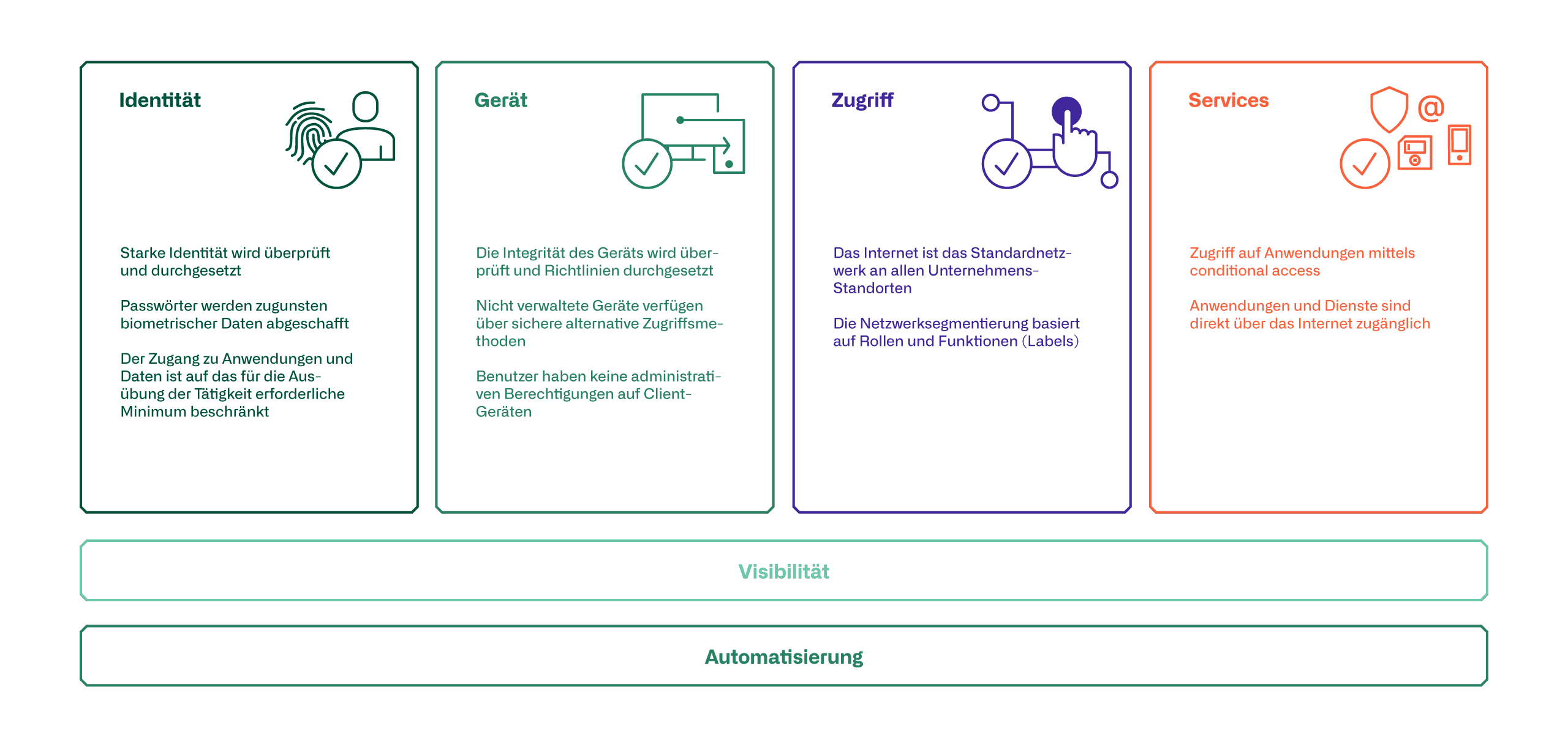

Was ist ein mögliches Vorgehen in den einzelnen Bereichen?

Die nachstehende Abbildung zeigt eine mögliche Übersicht über die Zero Trust Maturität, die wir zusammen mit den Kunden in unseren Projekten erreichen möchten. Diese Maturitätsziele stellen zwar nicht den gesamten Umfang der ZTA dar, sie erfassen jedoch die wichtigsten Bereiche. Zusammen mit dem Kunden erfassen wir die aktuelle Situation und bestimmen, in welchen Bereichen der grösste Handlungsbedarf besteht. Die wichtigsten Aktivitäten sind pro Bereich aufgelistet.

Identität

Um die Sicherheit der Identitäten zu verbessern, sollte unbedingt MFA eingeführt, um den administrativen Zugriff auf Server und Ressourcen zu kontrollieren. Später soll diese Anforderung der Multifaktor-Authentifizierung auf alle Benutzer ausgeweitet werden, die von außerhalb des Unternehmensnetzwerks auf Ressourcen zugreifen. Ein zentrales IAM wird dafür vorausgesetzt.

Gerät

Der erste Schritt in Richtung Geräteüberprüfung ist die Registrierung von Geräten in einem Geräteverwaltungssystem. Darüber hinaus sollte mit der Verwaltung begonnen werden, um eine ordnungsgemäße Validierung des Gerätezustands zu ermöglichen. Das ist eine grundlegende Komponente, um Richtlinien festzulegen und auf den Geräten durchzusetzen.

Dies gilt sowohl für Unternehmens-eigene Geräte als auch für persönliche BYOD-Geräte. Wenn Mitarbeiter ihre persönlichen Geräte für den Zugriff verwenden möchten, müssen die Geräte registriert werden und denselben Richtlinien unterliegen, die auch für unternehmenseigene Geräte gelten. Für Geräte, bei denen eine Registrierung in der Geräteverwaltung nicht möglich ist, soll ein alternative Zugriffsmöglichkeit, wie z.B. ein Virtual Desktop zur Verfügung gestellt werden.

Zugang

Im Bereich der Zugriffsverifizierung sollte der Fokus auf der Segmentierung von Benutzern und Geräten (speziell auch IoT-Geräte) in eigens dafür eingerichteten Netzwerken (Macro- und Micro-Segmentierung) sein. Eine Umstellung des Zugriffs aller Mitarbeiter mittels Internet kann ein nächste Schritt Richtung Zero Trust sein.

Services

Um eine vollständige Validierung der Zugriffe zu erreichen, müssen vor allem ältere Anwendungen modernisiert oder spezielle implementiert werden. Eine Ablösung dieser Legacy Anwendungen hätte zusätzlich den Vorteil, dass die Abhängigkeit von VPN entfällt. In der Praxis ist dies jedoch nicht umsetzbar, deshalb braucht es dafür Hybride Lösungen.

Wie sieht die Transition in eine ZT Architektur aus?

Jedes Unternehmen, das eine Zero Trust Architektur einführen möchte, muss individuell herausfinden, welcher Ansatz und welches Vorgehen am besten zu seiner Umgebung passt. Dazu gehören die Abwägung von Risikoprofilen, die Festlegung des Umfangs der Zero-Trust-Implementierung und die Bestimmung der spezifischen Überprüfungen, die für den Zugriff auf Unternehmensressourcen erforderlich sind. Bei all dem ist die Förderung der unternehmensweiten Akzeptanz von Zero Trust entscheidend für den Erfolg, unabhängig davon, wo Sie mit der Umstellung beginnen möchten.

Die wichtigsten Erkenntnisse aus unseren bisherigen Projekten:

- Sammeln Sie Telemetriedaten, bewerten Sie die Risiken und setzen Sie sich dann Ziele.

- Führen Sie moderne Identitäten und MFA ein

- Konzentrieren Sie sich bei der Durchsetzung der Zugriffskontrolle auf die am häufigsten verwendeten Anwendungen, um eine maximale Abdeckung zu gewährleisten.

- Beginnen Sie mit einfachen Richtlinien zur Durchsetzung des Gerätezustands, wie z. B. Gerätesperre oder Passwortkomplexität.

- Führen Sie Pilotprojekte durch.

- Konzentrieren Sie sich auf die Benutzererfahrung, denn sie ist entscheidend für die Produktivität und die Arbeitsmoral der Mitarbeiter. Ohne Akzeptanz wird Ihr Programm nicht erfolgreich sein.

- Kommunikation ist der Schlüssel – nehmen Sie Ihre Mitarbeiter mit auf die Reise!

Gerne unterstützen wir Sie bei der Analyse, Konzeption und Implementation einer Zero Trust Architektur.

Cyber Desaster Recovery

Die Cyber-Angriffe auf Unternehmen in der Schweiz nehmen stetig zu. So waren im letzten Jahr gleich mehrere grössere Schweizer Unternehmen, wie die Swatch Group, Stadler-Rail, Comparis oder erst neulich das Casinotheater Winterthur in den Schlagzeilen, weil sie Opfer eines Cyber-Angriffs wurden.

Bei den meisten Cyber-Angriffen handelt es sich dabei um Erpressungsversuche durch die Täterschaft. Mittels Ransomware werden die unternehmenskritischen Daten verschlüsselt und / oder Daten werden gestohlen, um mit der Veröffentlichung zu drohen. Die letzten Vorfälle zeigen sehr gut auf, dass die Angreifer nicht spezifisch auf Branchen oder grosse Unternehmen losgehen. Vielmehr verbessern die Angreifer von Zeit zu Zeit ihr Vorgehen, so dass Sie die Mittel besitzen, um jegliche Unternehmen aus verschiedensten Branchen anzugreifen, wobei auch vor KMU Betrieben nicht haltgemacht wird. Die einzige Option, die dann den Unternehmen bleibt, um nicht auf die Erpressung einzugehen, ist die Wiederherstellung der Daten. Auch neue Trends im Zeitalter der Digitalisierung stellen ein breites Spektrum an Herausforderungen dar, da sich mit den neuen Technologien auch neue Angriffe entwickeln. So ist immer häufiger von einer fortgeschrittenen, anhaltenden Bedrohung (Advanced Persistent Threat, APT) auszugehen. Unter APT wird ein ausgeklügelter, langfristiger Cybe-Angriff verstanden, bei dem ein Angreifer über einen längeren Zeitraum unbemerkt in ein Netzwerk eindringt, um unternehmenskritische Daten zu stehlen. Solche APT-Angriffe sind sorgfältig geplant und darauf ausgelegt, die Organisation zu infiltrieren, bestehende Sicherheitsmassnahmen zu umgehen und unentdeckt zu bleiben, bis das Ziel erreicht wurde.

Unter der Berücksichtigung der zunehmend ausgereifteren Angriffen und besonders der Gefahr, dass die Angreifer sich bereits über mehrere Monate hinweg im Netzwerk und den Systemen befinden, sind die bisher bekannten Desaster Recovery Konzepte auf ihre Wirksamkeit zu hinterfragen. Kann nun bei Eintritt eines Sicherheitsvorfalls dem Backup vertraut werden? Wie lange befindet sich der Angreifer bereits auf den Systemen und wie weit reicht das Backup zurück? Zusammengefasst kann in solch einer Situation dem Desaster Recovery Plan nicht vertraut werden! Ganz nach der Vorgehensweise «assumption of compromise» (englisch für «Vermutung der Kompromittierung») gehen wir im Verlauf dieses Blogs auf eine Möglichkeit ein, wie das Desaster Recovery in Zukunft auszusehen hat, um der Gefahr von solchen APTs entgegenzuwirken.

Was ist Desaster Recovery? Wieso hilft hier gerade ein klassisches Desaster Recovery nicht?

Der Zweck einer Desaster Recovery Planung besteht darin, ein Unternehmen dabei zu unterstützen, im Falle einer Störung weiterhin kritische Dienste anbieten zu können und eine katastrophale Unterbrechung der Aktivitäten zu überleben. Es geht darum die Verfügbarkeit unter den Informationssicherheitszielen zu gewährleisten, wobei es meistens eine der letzten Massnahmen eines Unternehmens ist, da alle vorgelagerte, erkennende und schützende Massnahmen nicht gegriffen haben. Häufig anzutreffende Konzepte in der Praxis beinhalten ein ausgelagertes Backup in separate Lokationen, zusätzliche Sicherung auf Tapes oder womöglich die Auslagerung des Backups zu einem Provider mit Ransomware Schutz. Fakt ist, dass diese Massnahmen gegenüber APTs nutzlos sind, da meistens bei einem Vorfall die genaue Dauer seit dem Eindringen des Angreifers nicht bekannt ist. Wird in so einem Fall eine Wiederherstellung durchgeführt, so muss stark davon ausgegangen werden, dass der Angreifer nach wie vor Zugriff auf die Systeme hat und seinen Angriff fortsetzen kann. Doch was kann man dagegen unternehmen?

Was verstehen wir unter Cyber Desaster Recovery? Was gilt es zu berücksichtigen?

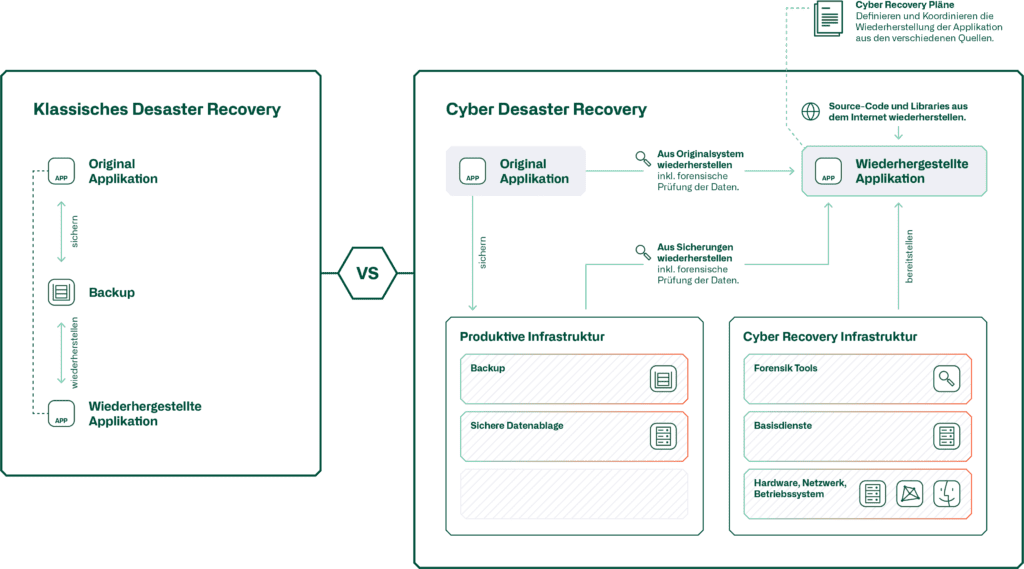

Während bei einem gewöhnlichen Desaster Recovery jeweils das Backup in die produktive Umgebung wiederhergestellt wird, ist der Unterschied zum Cyber Desaster Recovery, dass die Wiederherstellung in die produktive Umgebung nicht möglich ist, da davon ausgegangen wird, dass sie kompromittiert ist. Abhängig vom Ziel, welches das Unternehmen bei so einem Sicherheitsvorfall verfolgt, existieren aus unserer Sicht zwei mögliche Handlungsoptionen.

Handlungsoption 1 wäre die klassische Wiederherstellung der Anwendungen aus dem Backup in die produktive Umgebung. Entscheidet sich ein Unternehmen für diese Option, so muss stark davon ausgegangen werden, dass die Wiederherstellung nach kurzer Zeit wieder durchgeführt werden muss. Vorteile dieser Option sind die kurzen Wiederherstellungszeiten der Anwendungen aufgrund geringer Komplexität sowie die Vermeidung von zusätzlichem Betriebsaufwand für eine abgetrennte System- und Netzwerkinfrastruktur. Langfristig ist das jedoch nicht die beste Lösung.

Handlungsoption 2, die langfristige Cyber Desaster Recovery Lösung, würde bei solch einem Sicherheitsvorfall die Wiederherstellung der Anwendungen in eine abgetrennte System- und Netzwerkinfrastruktur vorsehen. Im Vergleich zur Handlungsoption 1 würde die Cyber Desaster Recovery Variante den Aufwand für das wiederholte Wiederherstellen der Systeme ersparen und das Risiko zur erneuten Kompromittierung reduzieren. Auf der anderen Seite steigt dafür die Komplexität des Wiederherstellungsprozesses der Anwendungen und somit deren Wiederherstellungszeiten. Ebenfalls ist durch den Betrieb einer abgetrennten System- und Netzwerkinfrastruktur mit einem höheren Betriebsaufwand zu rechnen.

Um herauszufinden, welche der beiden Optionen für Sie nun in Frage kommt, haben wir Ihnen nachfolgend die wichtigsten Entscheidungskriterien aufgelistet.

- Wie lange darf die Wiederherstellungszeit der Anwendungen dauern?

- Wie hoch darf der Wiederherstellungsaufwand, sprich die Komplexität sein? Sind wir denn im Besitz der notwendigen Ressourcen (technisch als auch personell)?

- Effektivität der Wiederherstellung hinsichtlich den Informationssicherheitszielen der Integrität und Vertraulichkeit. Mit anderen Worten ausgedrückt: Möchte man eine Wiederherstellung durchführen, welche eine Re-Infektion erlaubt oder nicht?

- Funktionsfähigkeit der Anwendungen – Bedeutet, ob das System isoliert oder nur in einem Verbund mit anderen Schnittstellen genutzt werden kann?

Welche Option am Ende gewählt wird, liegt an der gemeinsamen Entscheidung von Business und IT.

Damit ein Cyber Desaster Recovery im Unternehmen aufgebaut werden kann, sind folgende Vorbereitungsaufgaben zu treffen:

- Aufbau einer abgetrennten / isolierten System- und Netzwerkinfrastruktur

- Erarbeiten von Cyber Recovery Pläne für die verschiedenen Anwendungen und deren Systeme

Beide Vorbereitungsaufgaben werden wir uns innerhalb dieses Blogbeitrages noch etwas genauer anschauen, um so das Verständnis zum Cyber Desaster Recovery diesen zwei Aufgaben zu schärfen.

cyber security

Wir stehen Ihnen bei allen Fragen zur IT-Sicherheit zur Seite

Lesen Sie hier mehr

Cyber Recovery Infrastruktur

Um das vorgängig beschriebene Szenario lösen zu können, ist es essenziell, dass für das Cyber Desaster Recovery eine möglichst abgetrennte System- und Netzwerkinfrastruktur betrieben wird. Wichtig dabei ist, dass auch an die notwendige Infrastruktur für die Clients gedacht wird. Diese sollte ebenfalls für einen Desaster Fall vorgehalten werden.

Bei dem Design der Cyber Recovery Infrastruktur ist es wichtig den Umfang im Voraus zu definieren. Anhand dieser Informationen kann bestimmt werden, wie gross die Umgebung sein muss oder mit anderen Worten ausgedrückt, wie viel Rechenleistung und Speicher in der abgetrennten Umgebung vorgehalten werden muss. Im Grundsatz empfehlen wir diese Umgebung so klein wie nur möglich zu halten, um so den Betriebsaufwand möglichst gering zu halten. Im Idealfall fokussiert sich der Umfang auf die essenziellen, businesskritischen Anwendungen und deren Systeme ihres Unternehmens.

Der nächste wichtige Aspekt im Zusammenhang mit der Cyber Recovery Infrastruktur betrifft die Isolation dieser Umgebung. Dazu stellen sich zwei Fragen, die Sie für sich zu beantworten haben:

- Wie unabhängig muss die Cyber Recovery Infrastruktur von der produktiven Umgebung sein?

- Teilt man Systeme aus der produktiven Umgebung für den Betrieb der Cyber Recovery Infrastruktur oder benötigt sie eigene Systeme?

Beide vorgängig angesprochene Punkte haben einen grossen Einfluss auf den Betriebsaufwand. Immerhin muss berücksichtigt werden, dass der Betrieb (Patching, Lifecycle, etc.) für die Cyber Recovery Infrastruktur genauso wie für die produktive Umgebung gewährleistet werden muss.

Was auf keinen Fall vergessen gehen darf, ist der dritte Aspekt der Cyber Recovery Infrastruktur. Die abgetrennte Umgebung muss über einen Active Directory Service verfügen. Ohne ist der Betrieb nicht möglich.

Für die Umsetzung einer Cyber Recovery Infrastruktur ist die Berücksichtigung eines Cloud Anbieters durchaus sinnvoll. Mit dem Aufbau der Umgebung in der Cloud kann der Verwaltungsaufwand der Management Systeme für die Cyber Recovery Infrastruktur auf ein Minimum reduziert werden. Viele Betriebsaufgaben, die bei einer On-Premises Lösung aufkommen, fallen bei einer Cloud-Lösung weg.

Cyber Recovery Pläne

Die zweite Vorbereitungsaufgabe sieht die Erarbeitung von Cyber Recovery Plänen vor. Zu diesem Punkt gilt, dass pro Applikationsverbund, Desaster Recovery Pläne definiert werden sollen. Das Ziel der Pläne soll es sein, bei Eintritt des Desaster Falls der IT-Abteilung in Form einer Schritt für Schritt Handlungsanleitung zu dienen. Ausschlaggebend ist jedoch, dass im Vergleich zu den gewöhnlichen Recovery Plänen, sich die Cyber Recovery Pläne nicht nur auf den Wiederherstellungsprozess der Systeme aus dem Backup verlassen. In solch einem Fall ist es erforderlich, dass der Cyber Recovery Plan eines Applikationsverbunds aufzeigt, wie das Backup aus verschiedensten Quellen zusammengesetzt werden kann. Das Prinzip haben wir nachfolgend abgebildet.

Ein weiterer zentraler Punkt, welcher zwingend in die Cyber Recovery Pläne muss, ist die Auflistung der Abhängigkeiten, die Anwendungen zu anderen Systemen aufweisen. Es ist essenziell diese Abhängigkeiten klar zu definieren, um so im Bilde zu sein, welche Anwendungen zusätzlich wiederhergestellt oder vorhanden sein müssen, um die volle Funktionalität der businesskritischen Applikationen zu gewährleisten.

Wie wir Sie unterstützen können

Die Überarbeitung des Desaster Recovery Konzepts erfordert viel mehr als nur den Aufbau einer zweiten abgetrennten Infrastruktur an einer zweiten Lokation. Zusätzlich müssen auch Business Continuity Plan (BCP) Aspekte hinterfragt und entsprechend den neuen Cyber Recovery Plänen überarbeitet werden. Das sind unter anderem Punkte wie:

- Klare Festlegung der Verantwortlichkeiten im Plan

- Eindeutige Bestimmung der für jede Funktion im Plan verantwortlichen Personen

- Schrittweise Beschreibung des Wiederherstellungsprozesses

- Klare Identifizierung der verschiedenen Ressourcen, die für die Wiederherstellung und den weiteren Betrieb der Organisation erforderlich sind

- Festlegen und Kommunizieren der Umstände innerhalb der Organisation, unter denen der Desaster Recovery Plan ausgerufen werden sollte

Wichtig zu hervorheben ist, dass je nach Komplexität der Organisation ein oder mehrere Pläne für die verschiedenen Aspekte von BCP und Desaster Recovery erstellt werden können. Diese Pläne müssen nicht unbedingt in einen einzigen Plan integriert werden. Allerdings muss jeder Plan mit den anderen Plänen übereinstimmen, um am Ende eine tragfähige BCP-Strategie zu haben.

Wie festzustellen ist, müssen wie bei jeder technologischen Umstellung auch bei der Anpassung des Desaster Recovery Plans einige technische, administrative sowie operative Hürden überwunden werden – wir unterstützen Sie dabei gerne.

Mit unserem breiten Know-how und den Erfahrungen aus verschiedenen Projekten bei verschiedenen Firmen können wir Ihrem Unternehmen helfen, die Herausforderungen zu meistern und dank den Vorteilen die Sicherheit zu verbessern. Wir sind in der Lage die richtigen Mitarbeiter entsprechend abzuholen und einzubeziehen, so dass ihr Desaster Recovery Plan auch den neusten Gefahren aus dem Internet standhält. Nur mit den richtigen Rollen, den richtigen Prozessen, dem entsprechenden Engagement und einem durchdachten Konzept können die zusätzlichen Sicherheitsmassnahmen auch operativ in einem sinnvollen Rahmen betrieben werden.

atrete verstärkt die Teams Cyber Security und Digital Workplace & Collaboration

Das IT-Beratungsunternehmen atrete verstärkt sein Beraterteam mit den beiden Consultants Sven Köppel und Aldo Richner.

Sven Köppel arbeitet seit 1.9.2021 als Consultant im Bereich Digital Workplace. Vor atrete war er mehrere Jahre bei einem IT-Dienstleister in der Region Zug tätig, zuletzt in einer Schlüsselrolle bei der Einführung von IT-Infrastruktur Projekten mit Fokus auf Digital Workplace Themen. Er besitzt neben einem Abschluss der höheren Fachschule als dipl. Techniker HF Informatik auch Microsoft Zertifizierungen, so u.a. den Microsoft 365 Certified Enterprise Administrator Expert.

Aldo Richner ist seit 1.10.2021 neu im Cyber Security Team als Consultant tätig. Er hat mehrjährige Erfahrung als System Engineer. Sein Fokus lag zuerst auf dem Betrieb und der Weiterentwicklung der IT Infrastruktur sowie die Durchführung von komplexen Changes von Sourcing Infrastrukturen. In den letzten Jahren übernahm er vermehrt Aufgaben im Bereich Cybersecurity. Aldo Richner besitzt einen Fachhochschulabschluss der FHNW in Wirtschaftsinformatik (BSc) sowie Zertifizierungen im Requirements Engineering (IREB Foundation), ITIL Foundation in IT Service Management. Derzeit ist er in Ausbildung für das «CAS Cybersecurity und Information Risk Management» der FHNW.

Mikrosegmentierung: Vorteile und Herausforderungen

Mikrosegmentierung schützt die einzelnen Workloads, sorgt für mehr Transparenz und macht zudem die Compliance einfacher und effektiver. Nebst den technologischen müssen aber auch einige organisatorische Herausforderungen bei der Implementierung beachtet und gemeistert werden.

Wie die letzten Cyber-Vorfälle (u.a. Solarwinds) gezeigt haben, ist es Cyber-Kriminellen mit ihren riesigen Ressourcen möglich, alle Arten von Unternehmen in jeglichen Branchen und unabhängig davon, ob es eine On-Prem oder Cloud Infrastruktur ist, zu kompromittieren. Als Lösung für das Problem wird oft Mikrosegmentierung genannt: Verbesserte Sichtbarkeit der Netzwerk-Verbindungen, Schutz vor APTs (Advanced Persistent Threats), Unterbindung von lateral movement und durchgehende Einhaltung der Compliance.

Was ist Mikrosegmentierung?

Falls Ihnen dieser Begriff, beziehungsweise das Konzept völlig neu ist, möchte ich in diesem Absatz kurz darauf eingehen, was Mikrosegmentierung bedeutet und wie es ein Unternehmen implementieren kann, um die vertraulichen und sensiblen digitalen Assets zu schützen.

In wenigen Worten: Die Mikrosegmentierung ermöglicht es, das Netzwerk sehr feingranular und unabhängig von klassischen Netzwerksegmenten und IP-Adressen, typischerweise bis auf einzelne Workloads, zu unterteilen. Für jedes (Micro)Segment müssen dann Sicherheitskontrollen (Whitelist-Ansatz) definiert werden, die auf den Anforderungen der Datensicherheit basieren.

Traditionell waren Perimeter- und Zonen-Firewalls der primäre Verteidigungsmechanismus, um den unerlaubten Zugriff auf Systeme oder Applikationen zu unterbinden. Veraltete Regeln, Fehlkonfigurationen, offene Ports, wiederverwendete IP-Adressen usw. können es böswilligen Akteuren jedoch ermöglichen, in die Netzwerkinfrastruktur Ihres Unternehmens einzudringen. Das führt zur Kompromittierung wichtiger Anwendungen, Betriebssysteme oder Server und bedroht die Sicherheit der Daten. Bei der Mikrosegmentierung wird die Granularität der Filterung erhöht, es werden virtuelle oder host-based Firewalls für jeden Endpunkt im Netzwerk erstellt. Die gewonnene Transparenz und Möglichkeit, Verbindungen sehr granular zu definieren, unterstützt die Formulierung von strikten und spezifischen Sicherheitsrichtlinien und hilft dabei, die Angriffspunkte zu minimieren und das Ausbreiten im Netz zu erschweren.

Vorteile der Mikrosegmentierung

Es gibt verschiedene Vorteile der Mikrosegmentierung, von denen die wichtigsten im Folgenden aufgeführt sind:

- Schützt einzelne Workloads: Die Sicherheit durch Mikrosegmentierung reduziert Angriffsflächen und schützt einzelne Anwendungen und Workloads, die auch über verschiedene Infrastrukturen, wie z. B. in einer Multi-Cloud-Umgebung, verteilt sein können. Durch die sehr granulare Einschränkung der Verbindungen kann ein lateral movement verhindert werden.

- Erhöhte Automatisierung: Automatisierung mit starkem Fokus auf Integration über Schnittstellen (was neue Möglichkeiten der dynamischen Regelbildung ergibt), Zentralisierung und wiederverwendbare Sicherheitsrichtlinienvorlagen (vordefinierte und -bewilligte Verbindungen) sorgen für eine erhebliche Zeitersparnis und verhindern eine Überbeanspruchung von teuren Ressourcen.

- Vereinfachte Compliance: Die Mikrosegmentierung vereinfacht die Einhaltung von Vorschriften wie PCI-DSS, HIPAA oder GDPR durch eine klare Definition des Anwendungsbereichs und der Möglichkeit, die Segmentierung über alle Environments wie Hybrid- und Multi-Cloud zu forcieren. So entsteht die Möglichkeit, plattformübergreifend auditierbare und automatisierte Prozesse zu implementieren, welche bei Bedarf schnell an neue Compliance Anforderungen angepasst werden können.

- Infrastruktur-Übergreifende Segmentierung: Die Mikrosegmentierung bietet eine einfache, moderne und sichere Lösung zur Umgebungssegregation, egal wo und auf welcher Infrastruktur ihre Systeme laufen. So können zum Beispiel produktive Daten auf der on-prem Infrastruktur und Systeme von der Entwicklungsumgebung in der Public Cloud sehr granular getrennt werden.

- Verbesserte Sichtbarkeit: Die Mikrosegmentierung-Tools, welche oft aus Analysetools entstanden und weiterentwickelt wurden, bieten eine zentralisierte, granulare Echtzeit-Transparenz für alle Verbindungen im Netzwerk und reduzieren den Zeitaufwand für die Bewertung und Behebung von Problemen in hybriden Umgebungen. Durch die gewonnene Transparenz können zudem Angriffe schneller erkannt und somit APTs besser abgewehrt werden.

Herausforderungen bei der Implementierung

Die Implementierung von Mikrosegmentierung ist auch mit Herausforderungen verbunden:

- Anpassung der Infrastruktur: Die Implementierung wird Änderungen an der Netzwerktopologie und -architektur erfordern. Um den finanziellen Aufwand und das Risiko von Ausfällen zu minimieren, ist ein definiertes Vorgehen notwendig, das auf der Analyse der Verkehrsbeziehungen basiert.

- Anpassung der Prozesse: Sei es der Prozess für neue Systeme oder aber auch der Prozess für den Antrag neuer Verbindungen, es braucht eine gesamtheitliche Sicht und Optimierung der Prozesse. Die Prozesse müssen so weit optimiert und automatisiert sein, dass die zusätzlichen Massnahmen operativ auch umgesetzt werden können. Die teilweise neu benötigten oder neu zugeteilten Rollen müssen vom Management getragen und unterstützt werden. So müssen alle Kommunikationsbeziehungen vom Applikationsverantwortlichen definiert und erfasst werden, was teilweise einen Paradigmenwechsel im Mindset der Mitarbeiter bedeutet – hier können Automatisierung und der Einsatz von entsprechenden Tools helfen.

- Integration in die bestehende Tool-Landschaft: Die Automatisierung und das Einsetzen entsprechender Tools soll dabei helfen, die zusätzlichen Sicherheitsmassnahmen so einfach wie möglich umzusetzen und die Mitarbeiter bei ihren neuen Aufgaben zu unterstützen. Die Mikrosegmentierung funktioniert nur mit einer guten Orchestration und Integration in die bestehenden Tools über offene Schnittstellen.

- Lifcyle von Richtlinien: Durch die erhebliche Zunahme von Informationssicherheitsrichtlinien und Security-Policies ist ein entsprechendes Lifecycle-Management erforderlich. Auch hier können die entsprechenden Tools helfen und unterstützen, jedoch müssen die in allenfalls bestehenden Systemen integriert werden.

- Know-how über die Applikationen: Es ist notwendig, dass die Applikationsverantwortlichen ihre Applikation und vor allem deren Netzwerkverbindungen kennen und verstehen. Es reicht nicht das die Systeme mal bereitgestellt werden und dann anhand der analysierten Verbindungen die entsprechenden Rules erstellt werden. Grundsätzlich gilt, es gibt keine Verbindung, wenn diese nicht vorher definiert wurde. Die Unterstützung erfolgt mit entsprechenden Tools und Analysen, jedoch spielt auch hier der Mindset der Mitarbeiter eine Rolle.

Wie wir Sie unterstützen können

Die Anpassung der Strategie der herkömmlichen Zonierung hin zur Mikrosegmentierung erfordert nicht nur technische Anpassungen und die Einführung von neuen Tools zum Verwalten der hybriden Umgebungen (inkl. bestehenden klassischen Firewalls für Perimeter- oder Clientschutz). Es ist vielmehr eine Anpassung des Mindsets, eine Anpassung der Prozesse wie Systeme und Applikationen bereitgestellt werden, wie Verbindungen beantragt werden, eine Verschiebung von Verantwortlichkeiten und ein Weg in die Automatisierung der Netzwerkinfrastruktur. Es geht darum, den ganzen Lifecycle einer Applikation miteinzubeziehen, von der Entwicklung zum Release bis hin zum Abbau. Es geht um die Orchestration von verschiedenen Infrastrukturen (on-prem, hybrid- oder multi-cloud) und die technologieübergreifende Implementierung von Policies (host-based, network-based, cloud native).

Wie bei jeder technologischen Umstellung müssen jedoch auch bei der Implementierung von Mikrosegmentierung einige technische, administrative sowie operative Hürden überwunden werden – wir können Sie dabei unterstützen.

Mit unserem breiten Know-how und den Erfahrungen aus verschiedenen Projekten bei verschiedenen Firmen können wir Ihrem Unternehmen helfen, die Herausforderungen zu meistern und dank den Vorteilen die Sicherheit zu verbessern. Wir sind in der Lage die richtigen Mitarbeiter entsprechend abzuholen und einzubeziehen, so dass der Wechsel zur Mikrosegmentierung ein Erfolg wird. Nur mit den richtigen Rollen, den richtigen Prozessen, dem entsprechenden Engagement und einem durchdachten Konzept können die zusätzlichen Sicherheitsmassnahmen auch operativ in einem sinnvollen Rahmen betrieben werden.